鬼父百度影音

鬼父百度影音

文|华映本钱结伙东谈主邱谆

大模子行业泡沫正在披露。

2022年降生的ChatGPT,也曾在相等程度上结尾了大模子的Scalinglaw(标准定律)和通用才智表现。ChatGPT自身行为一个终局居品的生意化也连接有可以施展。据2024年7月的非公开数据,OpenAI的ARR(年频繁性收入)也曾达到了相等可不雅的41亿好意思元。

但这些收入都是在稀奇腾贵的算力、研发和运营成本基础上结尾的,而且细看最近OpenAI的发展,也很难称得上“得手”。本年以来,包括联创约翰·舒尔曼和伊利亚·苏茨克沃在内的多位中枢高管已离开,9月下旬更是接连发生了首席时刻官(CTO)米拉·穆拉蒂下野与苹果退出参与其最新一轮融资谈判的两大事件。

在华映本钱看来,惟有当GPT果真赋能通盘表层垂直行业应用场景,即结尾所谓大规模落地实践,以平台体式结尾生意化,OpenAI创始的LLM波澜才算透顶到来。但现时,非论是在toC如故toB侧,GPT都更像是一个超等APP,而非一个肖似IOS的底层平台。GPT插件和GPTs也曾诠释了底座LLM不行肤浅复制IOS的AppStore。

诚然OpenAI刚发布的o1模子用self-playRL的方法将scalinglaw推到了一个新的端倪,结尾了更强的推理逻辑才智,但上述“平台化瓶颈”并未得到根底改变。各垂直场景目下都尚未看到果真全面爆发的趋势。非论是在创业如故投资层面,大模子行业泡沫都已披露。这背后,结束GPT进行平台型生意化的根源究竟是什么?

在本年上半年推出的《再访硅谷:生成式AI遍地可见,VC动手温存国度安全类技俩丨华映本钱群众化不雅察》中,咱们先容了在生成式AI的波澜之中,硅谷在Agent、具身、算力、无东谈主驾驶等领域的发展情况,也提到华映温存“有底座大模子算法才智的垂直整合应用层公司”,那时华映本钱已预感了“应用方数据难整合”将是“GPT平台型生意化”的底层制约。

以下咱们将结合近期在硅谷深入探听当地多位大模子从业者后总结的大都心得,赓续对大模子创业、投资的困局以及潜在破局有操办进行更详备拆解。

著作篇幅较长,请参考以下目次:

一、AI投资逻辑困局

应用场景派

底层时刻派

二、时刻和生意化阶梯困局

东谈主工智能产业化的推行

数据困局

算力困局

三、潜在破局有操办

模仿互联网时期的想考

短期投资战略

永远可能演变

四、总结

*笔者为华映本钱外洋结伙东谈主、北大操办机学士及好意思国南加大多智能体(Agent)标的博士,Robocup冠部队成员、腾讯云操办早期T4行家级架构师。本文既非学术论文、也非生意行研文告,而是以一个AI学界出身、亲历硅谷多周期的投资东谈主视角分析现况和瞻望趋势。不雅点可能存在好多反共鸣之处,未必正确,但但愿这些视角能对您有所启发。同期,硅星东谈主驻硅谷资深记者Jessica对本文内容亦有孝敬。

一、AI投资逻辑困局

黄色日本目下AI领域投资东谈主以及创业者(尤其在国内)主要分红底下两个"派别":

应用场景派

持这个不雅点的投资东谈主,其投资标的是依靠对底座模子的调用结尾垂直行业大模子生意化的公司,创始东谈主粗犷是场景侧或居品配景,对于底座模子的深入雄厚并非必要。在作念该种投资采取时,需要应酬以下问题的挑战:

1.瞻望LLM能推动应用场景爆发的底层driver究竟是什么;

2.这个driver是否能连接、将来发展走向是什么;

3.应用的全面爆发需要资历哪些milestones。

要是投资东谈主对以上问题莫得皆备自洽的解答,盲目乐不雅押注应用场景的爆发,将催生投资和创业的泡沫。

底层时刻派

持这个不雅点的VC或创业者更聚焦底座大模子,即底层平台,以为将来一切都由AI平台驱动,是以不太纠结表层应用。这些大模子平台公司目下无边遭遇底下几个瓶颈:

1.表层杀手级应用迟迟未出现,好多时候需要底座公司躬行下场去场景侧作念定制化委派和实践;应用少也形成数据闭环无法形成;

2.表层应用门槛薄,险峻两层之间的鸿沟不明晰,底座的版块更新会“不小心”碾压表层应用,如GPT-3.5更新至GPT-4后对Jasper的碾压;

3.教练数据动手"清寒",Scalinglaw靠近停滞;

4.大模子平台公司对算力越来越依赖,成为"财富的游戏"。

前两条其实也正是应用场景派遭遇的根底问题,当下在表层应用迟未爆发、致使业界无法瞻望爆发期间点及爆发所需资历milestones的配景下,上述两类投资方法论暂时未能成效。

事实上这两种"派别"的区分,恰正是受互联网时期的公司可以明晰切分为"互联网应用"和"互联网平台"险峻两层的想维惯性所影响,但大模子在现时并莫得到达互联网时期这个"分层解耦"的阶段,是以这两个派别的差异本人就值得商榷。

二、时刻和生意化阶梯困局

东谈主工智能产业化的推行

要破解上文提到的诸多疑问,咱们必须先从雄厚大模子乃至通盘这个词东谈主工智能波澜的推行动手。广义的东谈主工智能在1956年的达特茅斯会议即宣告降生,但AI果真的产业化直到2012年傍边AlexNet的出现才结尾。AI产业化主要资历了底下两个阶段:

1.AI1.0深度学习(2012年AlexNet激勉):深度学习算法将海量数据进行教练后输出模子,来替代操办机科学几十年来聚积的算法和顺序,从而第一次结尾产业化。深度学习的大规模应用是“产业化AI”的推行,亦然“数据界说坐蓐力”的动手。

2.AI2.0废话语模子(2022年GPT3.5激勉):深度学习汇蚁集合多头自提神力(Transformer),并利用decoderonly和自追忆机制,更大数据集带来更大参数目模子的通用才智表现,结尾了ScalingLaw。

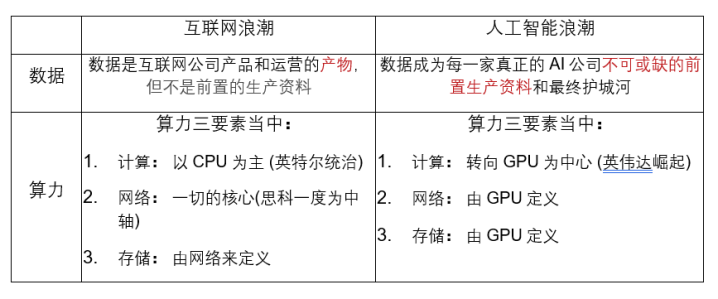

这两个AI产业化阶段的最根底点是:第一次制造了对于数据和算力的充分应用和依赖。针对这少量,咱们快速对比一下互联网和AI这两次大的波澜:

以上这些是LLM之是以能推动应用场景爆发的底层driver,但同期也制造了极大的门槛和困局。

数据困局

咱们先聚焦在数据这个维度,一个可以达成的共鸣是:自称“AI驱动”的企业都必须领有填塞的独少见据,才有填塞的护城河。只依靠调用底座模子而不掌执也不聚积独少见据的“AI公司”,即便径直调用API的短期遵循很好,也并不具备永远价值。GPTs和类Jasper公司的快速凋残已说明了这点。

那些宣称领少见据的AI公司,也频繁被数据的双刃剑困扰,即数据行为上风的同期也会制造瓶颈。针对这些公司咱们须先问底下的问题:

1.现时掌执的独少见据从何而来,数据量多大,是否有填塞的“独有门槛”;

2.独少见据清洗、抽取的成本是多大;

3.清洗后的数据怎样教练进入到垂直模子,从而推动底座模子在垂直领域进一步提高才智,鼓舞Scalinglaw。

不行齐全回复以上问题的“AI公司”,都靠近永远价值主义是否缔造的风险。但即便能骄慢这些要求的垂直领域公司,又会面对以下挑战:

1.用户的独少见据和底座模子的预教练数据在最终遵循呈现的归因上无法松懈解耦,应用层和平台层两边中枢价值的鸿沟不明晰。这个“紧耦合”同期也体现到了出现破绽之后包袱的切分上;

2.用户的独少见据在推动底座模子在垂直领域赓续出现才智表现的连接成本过于腾贵。最径直的成本来自于数据清洗成本和算力搭建、运营成本。

大模子的应用场景客户类型

咱们先来看LLM的四类典型应用场景的用户,以及他们怎样利用独少见据:

1.C端终局用户:径直和GPT聊天,或者利用肤浅提醒词工程,这里可以看作也在通过提醒词使用自身一些肤浅的用户独少见据。

2.B端终局客户:径直调用LLM的API接口来利用提醒词工程;或将独少见据向量化后存入向量DB,再作念RAG;或通过微调生成一些特定卑鄙任务模子。好多这类客户反应有可以的遵循。

3.B端服求实践公司:匡助上述B端客户当中不具备这些才智的公司来委派和部署这些经过,尤其是RAG和微调。

4.纯生意化居品公司:利用自身前期聚积的垂直领域独少见据、在底座模子上生成垂直模子后,以门径化居品的体式就业我方的C端或者B端客户,取得生意化文告。

前边三类LLM的应用场景事实上都结尾了可以的遵循和生意化,亦然OpenAI及肖似底座模子企业生意化的主体。但这些并不行撑持LLM需要完成的平台性的生意化生态。惟有当第4类公司大规模出现之后,LLM的平台性质的生意化才能果真爆发。严格来说,第4类公司里面有一部分是现存的老到阶段公司,如Adobe、Salesforce、Netflix等,他们借助LLM的才智进步了本来的居品,从而更好的就业了我方的客户。对比互联网时期,它们更肖似之前的线下零卖公司如苏宁、借助互联网修复了苏宁网购。但咱们更倾向把他们归到第2类公司。

咱们果真期待的是:与当年互联网时期的Amazon和淘宝这类新式纯互联网零卖企业对应的AI时期的“原生应用”企业动手表现。这么才能推动AI应用的大潮。可惜的是,目下从这类AI原生应用公司的终局客户的使费用上判断,并莫得看到规模化的迹象,因而业界不休有“大模子是否到了瓶颈或者泡沫化”的筹商。

垂直行业企业独少见据暂未被充分利用

聚焦上头列举的通盘B端公司,尤其是浩繁垂直行业的企业,如金融、医疗、法律、教授、媒体、旅游,制造业等。无疑这些垂直领域的浩繁企业也曾领有大都历史聚积的独少见据,即企业自少见据或专科的行业数据。而这些独少见据是否灵验取得充分利用,将极为要害。

鉴于上文诠释的AI产业化的实质,数据利用也曾成为大模子时期scalinglaw延续的基石,这点与AI之前的时期形成了显著分界。因此咱们对于独少见据是否得到充分利用的界说是数据能否匡助推动scalinglaw,即能否连接促进最终大模子的才智表现。这里循序探讨一下现时几种独少见据主流利用方法的实质和现况:

提醒词工程、险峻文体习

这些数据利用方法在C端以及小B应用里面占很大比例,实质上都可以归结为肤浅或高等的API调用。推动底座参数才智scalinglaw的力度有限。

RAG(检索增强生成)

是目下利用大部分企业独少见据事实上的最无边实践。其实质是检索加上极其复杂的险峻文体习。有时会结合Langchain等编排以及Agent智能体的方法,如微软的GraphRAG等。RAG要果真利用好的时刻门槛其实比大部分纯应用公司能承受的水平要高,好多会触及底座模子的细节,是以当今频繁依靠第三方就业公司去完成。

同期业界对于RAG是否能最终推动scalinglaw也有好多争论,笔者倾向于借用好多之前文件里对于“学生参加开卷检会”的譬如:一位本科学生参加法学检会,但他从未学习过法学院的教材,检会时在他眼前放了一堆可随时查阅的法律竹素,同期教化他一套极其复杂的查阅(检索)的方法,学生不需要都记着这些书里信息,只需遭遇法律问题时随时查阅就能给出可以的谜底。但这通盘这个词过程是否果真让他领有了法学院学生的才智并连接进步、即鼓舞了scalinglaw,值得探讨。

微调

企业客户基于底座模子作念微调的遵循在业界并莫得共鸣,好多从业者反应遵循可以,也有不少反应风险大且遵循未必好,目下不雅察到的事实是微调在企业场景应用实践少于RAG,况兼时刻门槛比较RAG更高,尤其在RM(奖励模子)和PPO(近端战略优化)方面,致使险些需要有很强底座模子教育的团队参与。

追忆历史,Google早期的BERT架构就界说了“通用任务预教练+卑鄙任务微调”的经过,遵循很好;进入GPT时期后,该架构得到延续,但因底座模子加大,微调成本升高,阻滞底座才智(渐忘)的风险增多,是以OpenAI主要用它结合垂直领域的东谈主类监督数据来作念对皆微调:SFT,RLHF(包括RM、PPO)等,来搁置无益、误导或偏见性表述,对皆才略域的价值不雅和偏好。延用上文对于学生的譬如,这类对皆式的微调有点肖似于想让本科毕业生尽快进入律所责任,但并非用法学院深造来增多他们的法律专科常识,而仅仅通过密集的上岗培训来让他们具备法务的话术和基本教化。

至于其他更多各样的微调方法,推行利用案例似乎并未几,时刻结尾也常堕入矛盾:一方面想改革一些底座的汇注参数,一方面又不敢动太多参数而亏损底座的通用才智,这个标准要是不是底座模子团队我方,其他东谈主可能都很难掌执。全量参数“微调”也曾接近下文说起的重新教练,风险和成本都增多;而非论是冻结如故低秩适合(LoRA)的方法,目下也都无法皆备幸免风险。事实上即便只作念对皆微调,能作念到最安全且最优遵循的可能也如故对底座模子结尾稀奇熟悉的团队。

Agent

大领域上可归类于后教练的高等妙技,其中包含Langchain等编排同期结合反想、打算、顾忌、器具使用、协同等产生LLM屡次调用的方法,以及包括进阶RAG里面利用的诸多妙技。Agent无疑是将来趋势,但利用尚在早期,有待进一步深化探索。目下非论表面如故实践上,都还暂难诠释是否解析多形势后对LLM的系统性反复调用(multishot)就能让底座LLM延续scalinglaw,尤其是怎样让独少见据更好地孝敬于这个延续,尚不明晰。

重新预教练、赓续教练

企业径直用我方的独少见据结合底座模子来重新教练我方的垂直模子,这在目下看彰着最伪善际,因此在闲居企业用户里面利用的案例无疑最少,除了算力和成本要素外,还有以下原因:

重新教练的独少见据和通用数据集的量与质料的配比很难掌执,这是底座大模子厂商的最核神思密和护城河。配比不正确,教练后模子的通用才智会大幅下跌(倒霉性渐忘)。对于赓续教练,也需要去计算底座模子用的通用数据集以及他们预教练到达的checkpoint等。Bloomberg利用自身大规模独有金融数据重新预教练出来了垂直金融大模子BloombergGPT,但遵循欠安,使费用很低,粗略率是这个原因;

莫得企业客户欣慰径直把我方的独少见据径直拱手献给底座大模子公司去讨好预教练。致使好多本人领有底座模子的巨头的里面应用居品部门也不肯意里面孝敬这些数据。

尽管业界有不雅点以为企业用独少见据重新教练相对RAG和微调上风并不大,但应该无东谈主皆备狡赖这个上风。尤其当企业和底座模子侧能充分讨好、即数据、教练算法乃至团队充分互通的时候,上风如故具备的。有计划词怎样能规模性地达成这种理想化讨好而搁置上述的割裂,正是GPT类底座公司果真生意化的用功:

垂直行业企业:领有大都垂类数据,但对底座模子的教练算法、数据集乃至预教练到达的checkpoint都不了解;底座模子公司:难以触达和获取通盘企业客户的垂类数据。

因此领少见据的场景方和领有教练算法的底座方在实践中产生了割裂,大模子时刻栈的险峻两层不仅莫得互相促进而产生飞轮效应,反而互为制约。

企业独少见据无法皆备参与底座大模子的赓续教练,是形成“数据不及”逆境的进军原因。一方面怀恨预教练数据“清寒”,一方面又不行充分利用垂直行业的独少见据,是当下类GPT架构的一大缺憾。尽管业界也有大都对合成数据或仿真数据的探索,但其成本限定和输出质料都仍处于早期。过度防范成本高且质料交集的合成数据而撤废已有的大规模垂直行业数据的作念法也值得深想。

总而言之,GPT界说的主流“底座预教练+独少见据RAG或微调”的架构暂时无法推动更大表现。垂直应用场景企业的独少见据尚未能充分孝敬于scalinglaw程度,这是大模子目下未触发大规模落地应用的中枢根源之一。

算力困局

为突破英伟达显卡带来的高额算力成本插足的僵局,好多卑鄙行业玩家推出“垂直行业小模子”或者“端侧小模子”,但可惜在时刻阶梯上很难果真有捷径可走。这些小模子,除了通过RAG或者微调生成的模子、也包括大模子蒸馏后的小模子,即用大模子坐蓐数据去教练出的模子,以及对大模子编订、压缩、剪枝后的模子。他们都有一个共同点:起原和中枢价值仍在大模子上。

除了上述这些以外,产业实践中也还存在以下类型的小模子:

基于非GPT、或非Transformer架构的模子汇注,如BERT、CNN、RNN、Diffusion以及RL等;

其他更传统的非深度学习、致使基于顺序的“模子”。

这些小模子可看作是针对大都细节长尾卑鄙场景的极端处理,更多仍需要对位于中心的大模子去扶直张开,逾额价值目下有限,其果真价值仍聚合于大模子。这里借用张宏江博士在腾讯深网的访谈里对于“小模子”的讲述:

应该先“把大模子的性能作念好,才能果真出现表现”,再“通过蒸馏的方法和连接学习的方法把它作念小,而不是一动手就作念个小模子”。

三、潜在破局有操办

模仿互联网时期的想考

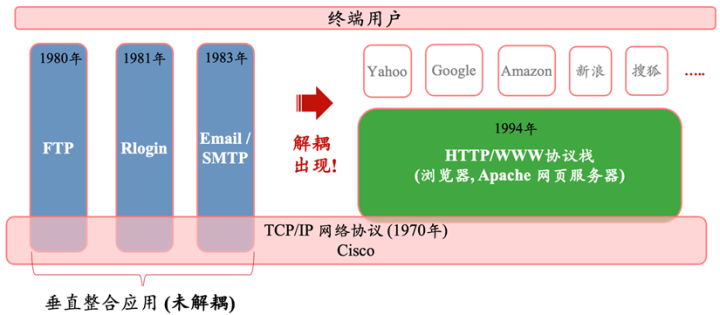

为进一步想考上文说起的时刻栈无法解耦和单干的根底状态,咱们再追忆一下互联网的历史。咱们比较民俗提的互联网,事实上是从1994年浏览器的出现动手的“Web互联网”,而广义的互联网早在1970到80年代就也曾出现,最早的样式是FTP、Rlogin、Telnet以及Email电邮等“垂直整合应用”的居品样式。直到Web和浏览器行为平台(下图中的绿色框)出现之后,大都肖似Yahoo等基于网页体式的纯应用才果真与底层解耦,从而接踵在各个垂直行业爆发,如零卖行业的Amazon、旅游行业的Expedia、媒体行业的Netflix等等。

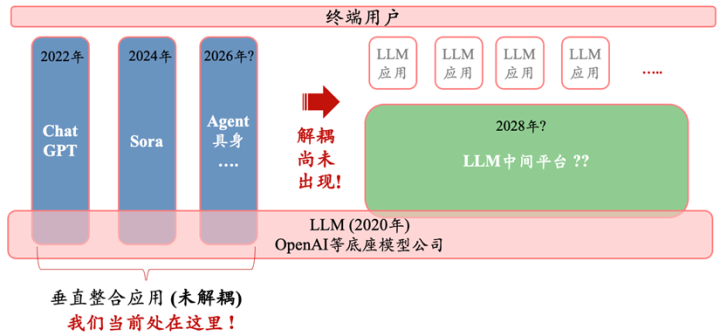

到了大模子时期,咱们最先看到的亦然ChatGPT、Claude、Character。AI、Sora等“垂直整合应用”的居品样式,但由于前文提到的独少见据利用的困局,底层平台和表层应用充解析耦的阶段其实尚将来临。LLM大模子时期的平台(下图中的浅绿色框)尚未出现。

咱们这里所说的平台更准确地应称为“操作系统(OS)”。OS的中枢功能即是阻遏表层应用和基层时刻细节,让应用公司可以聚焦居品和运营、从而规模化结尾落地和生意化。OS的具体例子即是互联网时期的浏览器、PC时期的Windows、以及挪动时期的IOS和安卓。OS与想科这么的基础设施(Infra)的中枢区别是:Infra的实质是器具,它无法将应用层与底层灵验切分出来;Infra的调用者频频如故需要对基层时刻有深切的雄厚,才能将器具利用的好;是以Infra自身无法催生大规模应用生态。OpenAI与它的同业们误以为我方创造了肖似苹果这么的的平台即OS,但事实上仅仅创造了肖似想科的Infra。比较互联网和挪动互联网的程度,可以说大模子还处在“前浏览器或前IOS时期”。

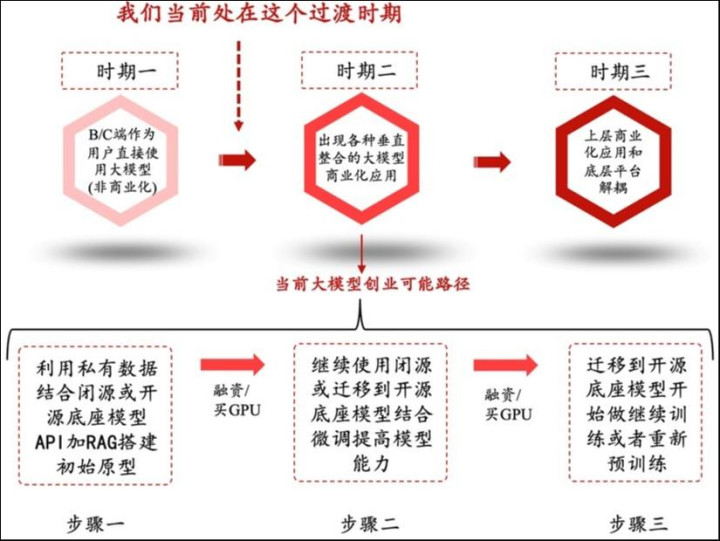

咱们以为大模子时期和互联网时期肖似,也会资历以下三个发展阶段(尽管每个阶段的历时可能与互联网不尽疏通):

阶段一:B/C端用户径直使用大模子;

阶段二:出现各式垂直整合的大模子生意化应用;

阶段三:表层生意化应用和底层平台充解析耦,落地应用爆发,底座模子规模性变现。

现时咱们处在的是“阶段一”也曾完成、“阶段二”刚刚动手的过渡时期。

短期投资战略

“垂直整合应用派”

轮廓以上论断:大模子当下的时刻生态架构尚未到达互联网老到时期的明晰分层阶段,互联网当年的“应用场景驱动”的投资逻辑暂时难以套用。在此配景下,咱们将忽视“第三种派别”的投资逻辑,即聚焦既非纯应用场景、也非纯底座模子的公司,而是“垂直整合应用”公司。这类第三种公司的齐全界说是:

具备底座大模子算法才智、但撤废作念通用底层平台的端到端的垂直整合应用。

通盘这三种类型的公司有可能会分别出现如下的发展:

应用场景公司

这类应用公司在大模子时期的创业壁垒会远高于互联网时期,可能很难保持在纯应用的样式:

1.须将领有独少见据行为先决要求,并有才智后期连接聚积数据。互联网时期应用公司强调的“飞轮”效应,在大模子时期必须包含独少见据的参与,这成为飞轮形成前“冷启动”的最大门槛;

2.须时刻栈下沉,不休拓展底座模子算法才智,连接将独少见据教练进应用侧模子,在垂直领域推动scalinglaw。

正因为此,对于“应用场景驱动”的投资机构而言,判断应用公司投资价值的门槛也大大提高,即不仅要判断创始东谈主的垂直领域教育和居品才智,还要深入检会他们获取、清洗数据的才智,以及将这些数据教练到垂直行业模子的底座时刻的水平。

底座模子公司

对于类OpenAI的底座模子公司、包括开源和闭源的公司,如Anthropic、Llama、Mistral、智谱、Kimi等,咱们瞻望它们还会赓续迭代模子从而延续scallinglaw,比如OpenAI最新的o1模子等。但这些迭代仍只会延续超等App的居品样式而无法短期成为底层平台。

对于这类公司,尽管短期探索平台型生意化靠近难度,但若撤废行为通用平台的诉求,锁定一个垂直领域专心征集垂类数据、从而教练出果真的垂直整合大模子的空间会更大。这对于OpenAI也许无法撑持目下估值,但对于其他估值略低的底座大模子玩家应该是可行出息。咱们看到也曾有不少这类公司在作念肖似的聚焦转型,但要是不行果真撤废想成为底层平台去赋能应用的述求,仍将堕入上述的数据困局。

垂直整合应用公司

这个第三种旅途对于皆备初创的企业彰着詈骂常高成本高风险的,很难一蹴而就,因而可以沟通经受底下的三个循序渐进的形势:

形势一:利用独少见据基于底座模子API加RAG搭建启动原型(同期全力融资和囤GPU);

形势二:基于底座模子结合微斡旋Agent等方法提高模子才智(同期全力融资和囤GPU);

形势三:利用更多独少见据动手作念赓续教练或者重新预教练(赓续全力融资和囤GPU)。

在硅谷,“垂直整合应用”公司占到了VC投资的很大比例,如Cohere(企业大模子)、Harvey(AI法律大模子)、Perplexity(AI搜索)、EurekaLabs(AI教授)、Augment(AI编程)、HolisticAI(AI企业管治SaaS),等都近期取得可以融资。这些公司的创始东谈主都是来自如Transformer作家、OpenAI、Deepmind、Meta等头部底座模子配景、并深耕各自不同垂直场景。

红杉在2023年9月题为“GenerativeAI'sActTwo”的博客里面也提到“Verticalseparationhasn'thappenedyet”的说法,期间曩昔一年,咱们以为这个“separation”依然莫得发生,并因为上头提到的数据强耦合等原因,红杉博客原文说的“verticallyintegrated”还会是个常态。

在中国国内,这个类型的公司还比较少,中枢原因在于具备底层模子才智的团队极其稀缺,但具备这些才智的团队又都执着于作念底层平台的述求。跟着几家头部模子公司(包括互联网大厂的底座模子团队)接踵遭遇上述瓶颈,它们中的一些中枢时刻东谈主员会动手脱落创办“垂直整合应用”公司;同期有几家头部底座模子公司我方也在转型到垂直整合场景,比如百川的医疗大模子、及零一的BeaGo等。

总结上文提到的大模子生意化的三个时期及现时可能的三个发展形势如下图,上述通盘这些中好意思的“垂直整合应用”公司也都各自处于三个形势的不同期间点。

多模态和具身智能

在投资上述“垂直整合应用”以外,多模态和具身智能(多模态的一种体式)亦然值得温存的投资标的。尽管它们更多是感知而非基础才智的进步,自身要杰出纯话语大模子(LLM)而更快结尾scalinglaw可能较难,但在纯话语大模子的生态修复遭遇瓶颈之时,无意可以探索平行于话语模子的算法架构及数据栈型式来搭建第三方生态。篇幅关联,这里不作念张开。

齐全时刻栈、Infra、芯片

今天的深度学习和LLM的高速演进,仍然仅仅通盘这个词操办机科学时刻栈的一个板块,而齐全时刻栈的通盘模块都在被LLM牵动着产生颠覆式的迭代。是以大都的契机将来自看似不是AI自身的时刻栈的其他边际,包括:

·Infra:包括底座模子自身,以过火他各层的Ops、各样toolchain,等等。华映本钱两家被投公司星尘和天云数据,即是DataInfra的典型代表,目下与硅谷好多DataOps公司相同也都在积极作念更稳健AI2.0的新兴数据栈的前沿探索。

·芯片:是惩办算力困局的终极妙技。现时主流GPT架构之下日益攀缘的算力成本压力和单一供应商依赖形成的惊险,将匡助新式GPU公司突破英伟达的CUDA设定的禁区,从而在某些领域颠覆英伟达的把持。

但上述两种契机都陪同一个雄伟的前提:无论是Infra如故AI芯片创业的创业者,都需要对底座废话语模子自身有相等深入的雄厚和教育。这点与之前对于应用层创业的要求事实上是一致的。

永远可能演变

OpenAI要突破现时的“泡沫”惊险,需要要点攻关的不仅是怎样不休提高我方底座话语模子的才智,更是怎样通过矫正后的时刻架构和生意生态,让其他领少见据的第三方应用场景方尽可能参与到scalinglaw的程度中来。大模子时刻栈发展依旧在一日沉,上文说起的好多担忧和“泡沫”有可能因为某些突破而得到一定化解。以下肤浅列出笔者有限想考后的可能性以及各自的挑战:

新的后教练(Post-training)方法出现与连接优化

RL(强化学习):OpenAI刚发布不久的o1的Self-PlayRL在赓续鼓舞scalinglaw,但它我方也提到了对于RL行为推理阶段的scalinglaw和与预教练阶段的scalinglaw具有不同特色,致使是否能将之称为RL的scalinglaw也有争议。但总之OpenAI的o1片面推动底座推理才智的尝试仅仅刚起步,暂时无法让领有大都独少见据的场景端客户参与进来、并永远受益。后教练潜在是可以offload给下旅客户结合我方的独少见据来进行的,但目下o1也还未能让第三方复现。但即便能以某种体式开放出来、交给下旅客户去连接进行RL算法更新,这么作念之后,只会让客户参与门槛比较之前用RAG和微调等主流的后教练方法还要更高。

RAG:如端到端的RAG、基于RAG的预教练模子等都詈骂常成心的尝试。但这类方法论也更考证了笔者前文诠释的“即便作念RAG也要从雄厚底座预教练模子动手”的不雅点。

Agent:如上文所述,智能体的探索具备雄伟空间和契机,但怎样最大化融入用户侧的独少见据仍然是课题之一。

预教练及推理成本和门槛大大裁汰

一方面算力层面即GPU芯片的突破,一方面是教练和推理的优化加快及工程化的起初。除此以外还有第三种可能,尽管前文要点说起的都是“AI三要素”当中的数据和算力的困局,但其实教练算法的突破和优化仍可能是最终裁汰成本的最大推力,包括对自追忆机制致使Transformer即提神力机制本人的优化致使重写等等。

透顶改变预教练+后教练的模式

前两种方法都在试图拓展OpenAI既定阶梯的飞腾空间,但想透顶改变这个阶梯的难度彰着要大好多。但当初投OpenAI的VC也未必意象到GPT阶梯可以从彼时占主流总揽地位的BERT阶梯分叉出来、而用decoderonly等机制开放了scalinglaw的全新空间。在将来几年之内,某个从GPT阶梯的再次根人道架构分叉,将会叠加当年OpenAI的得手,但此次颠覆对象是OpenAI我方,由此带来的将是scalinglaw的又一次无比雄伟的迈进。

四、总结

本文内容较多,咱们终末归纳为以下中枢两点:

1.目下大模子的应用层和底座层尚未解耦,是以投资战略不忽视只看纯应用或者纯底座模子,而可以暂时围绕上基层垂直整合的应用张开,同期需密切不雅察、恭候果真的平台/操作系统的出现;

2.应用和底座模子层未解耦的根底原因之一是在于数据在时刻栈内的强耦合鬼父百度影音,包括预教练与后教练数据集、即底座模子数据与卑鄙垂直数据的耦合,这个现况亦然由东谈主工智能即深度学习算法对数据依赖的推行所派生的。这些强耦合目下制约了scalinglaw的发展和大模子的规模化生意落地。